هذا الأسبوع في الذكاء الاصطناعي: هل يمكننا أن نثق في أن DeepMind أخلاقية؟

إن مواكبة صناعة سريعة الحركة مثل الذكاء الاصطناعي أمر صعب. لذا، إلى أن يتمكن الذكاء الاصطناعي من القيام بذلك نيابةً عنك، إليك ملخصًا مفيدًا للقصص الحديثة في عالم التعلم الآلي، إلى جانب الأبحاث والتجارب البارزة التي لم نغطيها بمفردنا.

هذا الأسبوع في مجال الذكاء الاصطناعي، أصدر DeepMind، مختبر البحث والتطوير في مجال الذكاء الاصطناعي المملوك لشركة Google، ورقة تقترح إطار عمل لتقييم المخاطر المجتمعية والأخلاقية لأنظمة الذكاء الاصطناعي.

إن توقيت الورقة – الذي يدعو إلى مستويات متفاوتة من المشاركة من مطوري الذكاء الاصطناعي، ومطوري التطبيقات، و”أصحاب المصلحة العامين الأوسع” في تقييم وتدقيق الذكاء الاصطناعي – ليس من قبيل الصدفة.

ستُعقد الأسبوع المقبل قمة سلامة الذكاء الاصطناعي، وهو حدث ترعاه حكومة المملكة المتحدة وسيجمع بين الحكومات الدولية وشركات الذكاء الاصطناعي الرائدة ومجموعات المجتمع المدني والخبراء في مجال الأبحاث للتركيز على أفضل السبل لإدارة المخاطر الناجمة عن أحدث التطورات في الذكاء الاصطناعي. بما في ذلك الذكاء الاصطناعي التوليدي (مثل ChatGPT وStable Diffusion وما إلى ذلك). هناك، تخطط المملكة المتحدة لإنشاء مجموعة استشارية عالمية معنية بالذكاء الاصطناعي على غرار اللجنة الحكومية الدولية المعنية بتغير المناخ التابعة للأمم المتحدة، والتي تضم طاقمًا متناوبًا من الأكاديميين الذين سيكتبون تقارير منتظمة حول التطورات المتطورة في الذكاء الاصطناعي – والمخاطر المرتبطة بها.

وتطرح شركة DeepMind وجهة نظرها بشكل واضح للغاية، قبل المحادثات السياسية على أرض الواقع في القمة التي تستمر يومين. ومن أجل منح الفضل عند استحقاقه، يقدم مختبر الأبحاث بعض النقاط المعقولة (إذا كانت واضحة)، مثل الدعوة إلى أساليب لفحص أنظمة الذكاء الاصطناعي عند “نقطة التفاعل البشري” والطرق التي يمكن بها استخدام هذه الأنظمة و متأصلة في المجتمع.

رسم بياني يوضح الأشخاص الأفضل في تقييم جوانب الذكاء الاصطناعي.

لكن عند تقييم مقترحات ديب مايند، من المفيد أن ننظر إلى مدى نجاح الشركة الأم للمختبر، جوجل، في دراسة حديثة أصدرها باحثون في جامعة ستانفورد، والتي صنفت عشرة نماذج رئيسية للذكاء الاصطناعي على أساس مدى انفتاحها في العمل.

تم تصنيف PaLM 2، وهو أحد نماذج الذكاء الاصطناعي الرائدة في تحليل النصوص من Google، على أساس 100 معيار، بما في ذلك ما إذا كانت الشركة المصنعة قد كشفت عن مصادر بيانات التدريب الخاصة بها، والمعلومات حول الأجهزة المستخدمة، والعمالة المشاركة في التدريب وغيرها من التفاصيل. %.

الآن، لم تقم شركة DeepMind بتطوير PaLM 2 – على الأقل ليس بشكل مباشر. لكن المختبر لم يكن تاريخيًا شفافًا بشكل ثابت فيما يتعلق بنماذجه الخاصة، وحقيقة أن الشركة الأم لم تلتزم بمعايير الشفافية الرئيسية تشير إلى أنه لا يوجد الكثير من الضغط من أعلى إلى أسفل على DeepMind للقيام بعمل أفضل.

من ناحية أخرى، بالإضافة إلى تأملاتها العامة حول السياسة، يبدو أن شركة ديب مايند تتخذ خطوات لتغيير التصور السائد بأنها تلتزم الصمت بشأن بنيات نماذجها وأعمالها الداخلية. التزم المختبر، جنبًا إلى جنب مع OpenAI وAnthropic، منذ عدة أشهر بتزويد حكومة المملكة المتحدة “بالوصول المبكر أو ذي الأولوية” إلى نماذج الذكاء الاصطناعي الخاصة بها لدعم الأبحاث في مجال التقييم والسلامة.

والسؤال هو: هل هذا مجرد أداء؟ لن يتهم أحد شركة ديب مايند بالعمل الخيري، ففي نهاية المطاف، يحقق المختبر إيرادات تقدر بمئات الملايين من الدولارات كل عام، وذلك بشكل أساسي عن طريق ترخيص عمله داخليًا لفرق جوجل.

ربما يكون الاختبار الأخلاقي الكبير التالي للمختبر هو Gemini، روبوت الدردشة المرتقب الذي يعمل بالذكاء الاصطناعي، والذي وعد الرئيس التنفيذي لشركة DeepMind، ديميس هاسابيس مرارًا وتكرارًا، بأنه سينافس ChatGPT الخاص بـ OpenAI في قدراته. إذا كانت شركة DeepMind ترغب في أن تؤخذ على محمل الجد على جبهة أخلاقيات الذكاء الاصطناعي، فسيتعين عليها أن تقدم تفاصيل كاملة وشاملة عن نقاط الضعف والقيود في Gemini – وليس فقط نقاط قوتها. من المؤكد أننا سنراقب عن كثب لنرى كيف ستسير الأمور خلال الأشهر المقبلة.

فيما يلي بعض قصص الذكاء الاصطناعي الأخرى الجديرة بالملاحظة من الأيام القليلة الماضية:

- وجدت دراسة مايكروسوفت عيوبًا في GPT-4: بحثت ورقة علمية جديدة تابعة لشركة مايكروسوفت في “الجدارة بالثقة” – وسمية – نماذج اللغات الكبيرة (LLMs)، بما في ذلك GPT-4 من OpenAI. وجد المؤلفون المشاركون أن إصدارًا سابقًا من GPT-4 يمكن حثه بسهولة أكبر من غيره من حاملي شهادة الماجستير في القانون على نشر نص سام ومتحيز. نعم كبيرة.

- يحصل ChatGPT على إمكانية البحث على الويب وDALL-E 3: الحديث عن OpenAI، أطلقت الشركة رسميا ميزة تصفح الإنترنت الخاصة به إلى ChatGPT، بعض بعد ثلاثة أسابيع من إعادة تقديم الميزة في النسخة التجريبية بعد عدة أشهر من التوقف. في أخبار ذات صلة، قامت OpenAI أيضًا بنقل DALL-E 3 إلى النسخة التجريبية، بعد شهر من ظهور أحدث تجسيد لمولد تحويل النص إلى صورة..

- منافسو GPT-4V: تستعد شركة OpenAI لإصدار GPT-4V، وهو البديل لـ GPT-4 الذي يفهم الصور وكذلك النصوص، قريبًا. لكن هناك بديلين مفتوحي المصدر تغلبا على هذا الأمر: LLaVA-1.5 وFuyu-8B، وهو نموذج من شركة Adept الناشئة الممولة جيدًا. لا يتمتع أي منهما بنفس قدرة GPT-4V، لكنهما قريبان من بعضهما البعض، والأهم من ذلك أنهما مجانيان للاستخدام.

- هل يستطيع الذكاء الاصطناعي لعب البوكيمون؟: على مدى السنوات القليلة الماضية، قام مهندس البرمجيات بيتر ويدن، ومقره سياتل، بتدريب خوارزمية التعلم المعزز للتنقل في اللعبة الكلاسيكية الأولى من سلسلة Pokémon. في الوقت الحاضر، لا تصل إلا إلى مدينة Cerulean – لكن Whidden واثق من أنها ستستمر في التحسن.

- مدرس لغة مدعوم بالذكاء الاصطناعي: تعمل Google على تطوير Duolingo من خلال ميزة بحث Google الجديدة المصممة لمساعدة الأشخاص على ممارسة مهارات التحدث باللغة الإنجليزية وتحسينها. سيتم طرح الميزة الجديدة خلال الأيام القليلة المقبلة على أجهزة Android في بلدان محددة، وستوفر ممارسة تحدث تفاعلية لمتعلمي اللغة الذين يترجمون من وإلى اللغة الإنجليزية.

- تطرح أمازون المزيد من روبوتات المستودعات: في حدث هذا الأسبوع، أعلنت أمازون أنها ستبدأ في اختبار روبوت Agility ذو القدمين، Digit، في منشآتها. ومع ذلك، وبالقراءة بين السطور، ليس هناك ما يضمن أن أمازون ستبدأ فعليًا في نشر Digit في مستودعاتها، والتي تستخدم حاليًا ما يصل إلى 750 ألف نظام روبوت، كما كتب بريان.

- محاكيات فوق محاكيات: في نفس الأسبوع الذي عرضت فيه Nvidia تطبيق LLM للمساعدة في كتابة كود التعلم المعزز لتوجيه روبوت ساذج يعتمد على الذكاء الاصطناعي نحو أداء مهمة بشكل أفضل، أصدرت Meta برنامج Habitat 3.0. أحدث إصدار من مجموعة بيانات Meta لتدريب عملاء الذكاء الاصطناعي في بيئات داخلية واقعية. يضيف Habitat 3.0 إمكانية مشاركة الصور الرمزية البشرية في المساحة في الواقع الافتراضي.

- عمالقة التكنولوجيا في الصين يستثمرون في منافس OpenAI: أعلنت شركة Zhipu AI، وهي شركة ناشئة مقرها الصين تعمل على تطوير نماذج الذكاء الاصطناعي لمنافسة OpenAI وتلك من شركات أخرى في مجال الذكاء الاصطناعي التوليدي، هذا الأسبوع أنها جمعت 2.5 مليار يوان (340 مليون دولار) من إجمالي التمويل حتى الآن هذا العام. ويأتي هذا الإعلان مع تصاعد التوترات الجيوسياسية بين الولايات المتحدة والصين – ولا تظهر أي علامات على التراجع.

- الولايات المتحدة تخنق إمدادات الصين من رقائق الذكاء الاصطناعي وفيما يتعلق بموضوع التوترات الجيوسياسية، أعلنت إدارة بايدن هذا الأسبوع عن سلسلة من الإجراءات للحد من طموحات بكين العسكرية، بما في ذلك فرض قيود إضافية على شحنات شرائح الذكاء الاصطناعي من إنفيديا إلى الصين. ستتأثر A800 وH800، شريحتي الذكاء الاصطناعي Nvidia المصممتين خصيصًا لمواصلة الشحن إلى الصين، بجولة جديدة من القواعد الجديدة.

- تنتشر نسخ الذكاء الاصطناعي لأغاني البوب بسرعة كبيرة: تغطي أماندا اتجاهًا غريبًا: حسابات TikTok التي تستخدم الذكاء الاصطناعي لجعل شخصيات مثل Homer Simpson تغني أغاني الروك في التسعينيات والعقد الأول من القرن الماضي مثل “Smells Like Teen Spirit”. تكتب أماندا: “إنها ممتعة وسخيفة ظاهريًا، ولكن هناك مسحة قاتمة للممارسة بأكملها”.

المزيد من التعلم الآلي

تؤدي نماذج التعلم الآلي باستمرار إلى التقدم في العلوم البيولوجية. كان AlphaFold وRoseTTAFold مثالين على كيفية التقليل من مشكلة عنيدة (طي البروتين) من خلال نموذج الذكاء الاصطناعي الصحيح. الآن قام ديفيد بيكر (مبتكر النموذج الأخير) وزملاؤه بتوسيع عملية التنبؤ لتشمل أكثر من مجرد بنية سلاسل الأحماض الأمينية ذات الصلة. بعد كل شيء، توجد البروتينات في حساء من الجزيئات والذرات الأخرى، والتنبؤ بكيفية تفاعلها مع المركبات أو العناصر الضالة في الجسم أمر ضروري لفهم شكلها الفعلي ونشاطها. يعد RoseTTAFold All-Atom خطوة كبيرة إلى الأمام لمحاكاة الأنظمة البيولوجية.

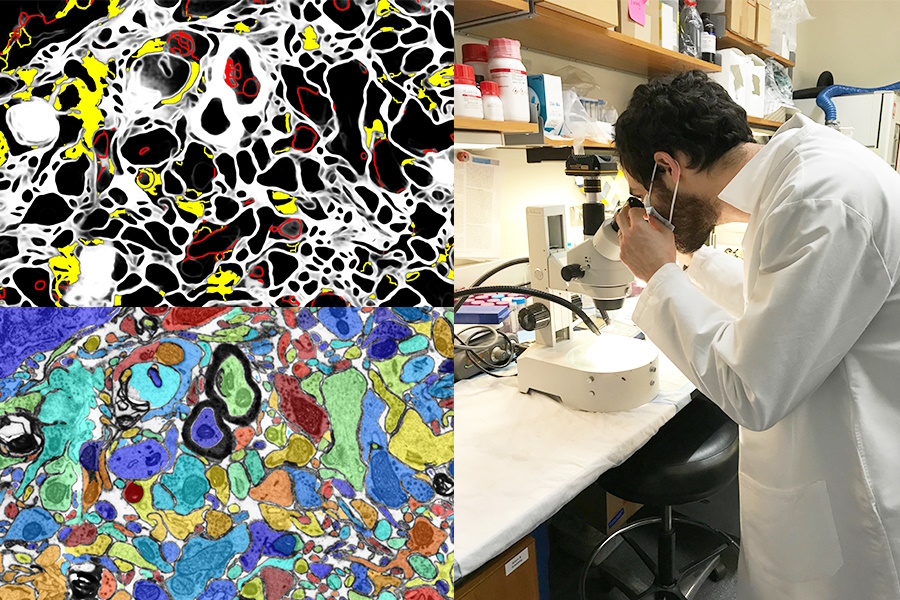

اعتمادات الصورة: معهد ماساتشوستس للتكنولوجيا / جامعة هارفارد

إن وجود ذكاء اصطناعي مرئي يعزز العمل المعملي أو يعمل كأداة تعليمية يعد أيضًا فرصة عظيمة. وضع مشروع SmartEM من معهد ماساتشوستس للتكنولوجيا وجامعة هارفارد نظام رؤية الكمبيوتر ونظام التحكم في التعلم الآلي داخل مجهر إلكتروني ماسح، مما يدفع الجهاز معًا لفحص العينة بذكاء. يمكنه تجنب المجالات ذات الأهمية المنخفضة، والتركيز على المناطق المثيرة للاهتمام أو الواضحة، وإجراء تصنيف ذكي للصورة الناتجة أيضًا.

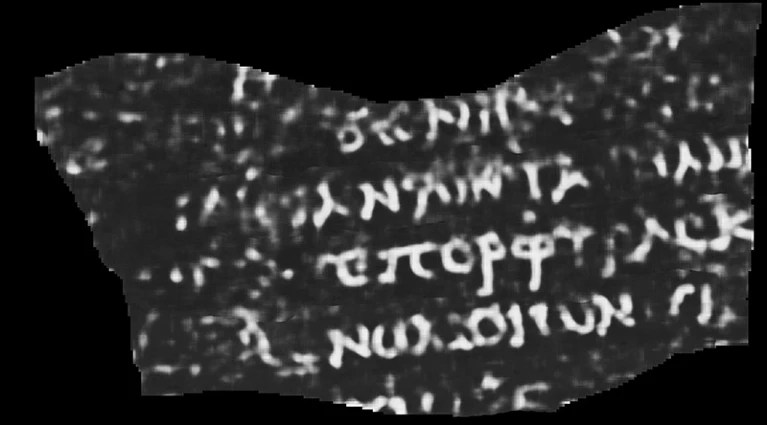

إن استخدام الذكاء الاصطناعي وأدوات التكنولوجيا المتقدمة الأخرى للأغراض الأثرية لا يصبح قديمًا (إذا صح التعبير) بالنسبة لي. سواء أكان الأمر يتعلق بكشف ليدار عن مدن المايا والطرق السريعة أو ملء فجوات النصوص اليونانية القديمة غير المكتملة، فمن الممتع دائمًا رؤيته. وتعد عملية إعادة بناء المخطوطة التي دمرت في الانفجار البركاني الذي دمر مدينة بومبي واحدة من أكثر الأعمال إثارة للإعجاب حتى الآن.

الأشعة المقطعية المفسرة بواسطة ML لورق البردي المحروق والملف. الكلمة المرئية تقرأ “أرجواني”.

قام لوك فاريتور، الطالب في جامعة نبراسكا لينكولن، بتدريب نموذج للتعلم الآلي لتضخيم الأنماط الدقيقة على عمليات مسح ورق البردي المتفحمة والملتفة والتي لا يمكن رؤيتها بالعين المجردة. لقد كانت هذه إحدى الأساليب العديدة التي تمت تجربتها في تحدٍ دولي لقراءة المخطوطات، ويمكن تحسينها لأداء عمل أكاديمي قيم. الكثير من المعلومات في الطبيعة هنا. ماذا كان في التمرير، تسأل؟ حتى الآن، مجرد كلمة “أرجواني” – ولكن حتى هذا فقد علماء البرديات عقولهم.

هناك انتصار أكاديمي آخر للذكاء الاصطناعي يتمثل في هذا النظام لفحص واقتراح الاستشهادات على ويكيبيديا. بالطبع، لا يعرف الذكاء الاصطناعي ما هو صحيح أو واقعي، لكنه يمكنه أن يجمع من السياق كيف تبدو مقالة واقتباسات ويكيبيديا عالية الجودة، ويبحث في الموقع والويب عن بدائل. لا أحد يقترح أن نسمح للروبوتات بتشغيل الموسوعة الإلكترونية الشهيرة التي يعتمدها المستخدمون، لكن هذا قد يساعد في دعم المقالات التي لا يوجد اقتباسات لها أو التي لا يكون المحررون متأكدين منها.

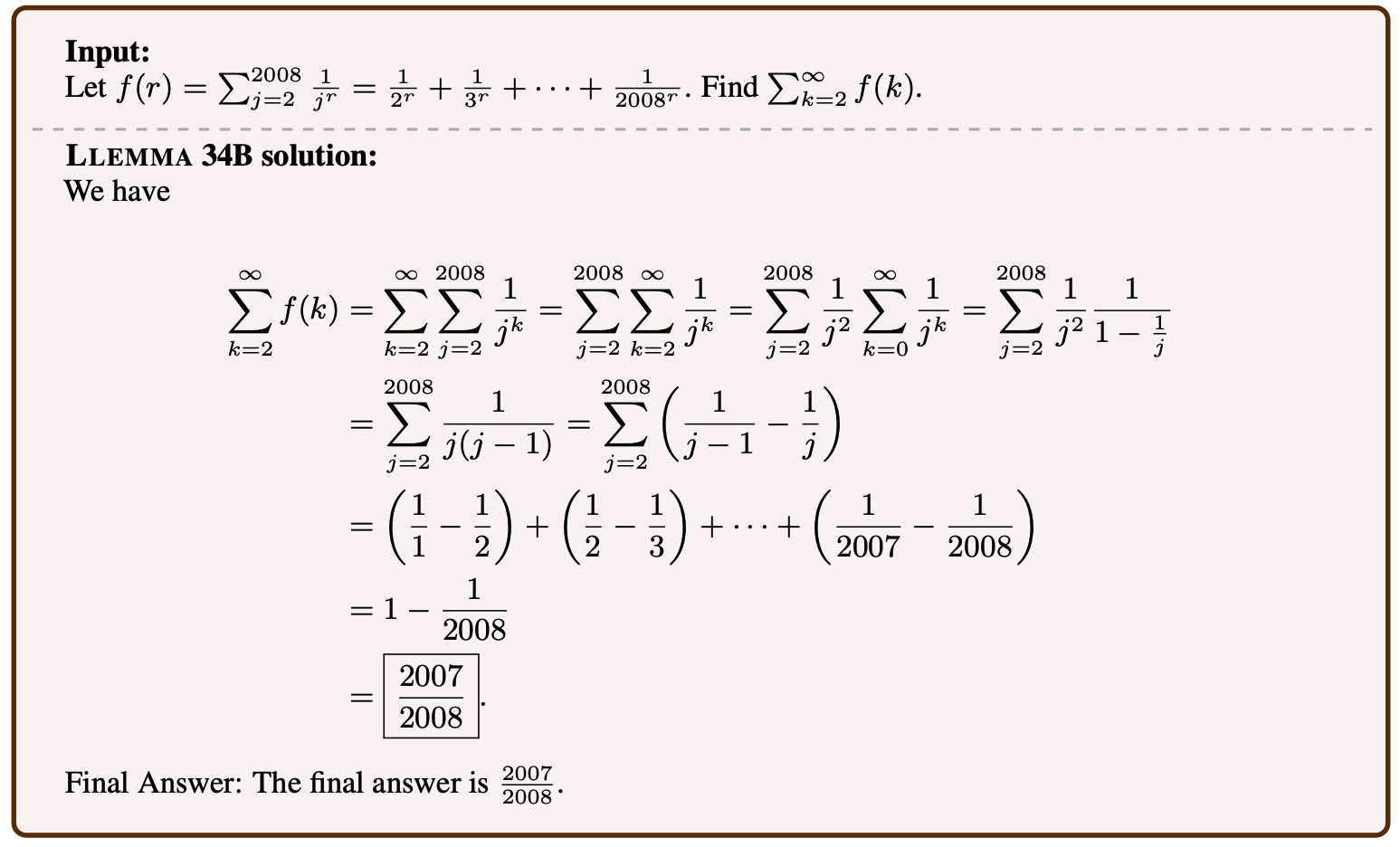

مثال على مشكلة رياضية يتم حلها بواسطة Llemma.

يمكن ضبط نماذج اللغة بشكل دقيق في العديد من المواضيع، ومن المثير للدهشة أن الرياضيات العليا هي واحدة منها. Llemma هو نموذج مفتوح جديد تم تدريبه على البراهين والأوراق الرياضية التي يمكنها حل المشكلات المعقدة إلى حد ما. إنها ليست الأولى – تعمل شركة مينيرفا التابعة لأبحاث جوجل على قدرات مماثلة – ولكن نجاحها في مجموعات مشاكل مماثلة وتحسين الكفاءة يظهر أن النماذج “المفتوحة” (بغض النظر عن قيمة المصطلح) قادرة على المنافسة في هذا المجال. ليس من المرغوب فيه أن تهيمن نماذج خاصة على أنواع معينة من الذكاء الاصطناعي، لذا فإن تكرار قدراتها في العلن يعد أمرًا ذا قيمة حتى لو لم يفتح آفاقًا جديدة.

من المثير للقلق أن Meta تتقدم في عملها الأكاديمي نحو قراءة الأفكار – ولكن كما هو الحال مع معظم الدراسات في هذا المجال، فإن الطريقة التي يتم تقديمها بها تبالغ في ترويج العملية. في ورقة بحثية بعنوان “فك تشفير الدماغ: نحو إعادة بناء الإدراك البصري في الوقت الفعلي”، قد يبدو الأمر كما لو أنهم يقرأون العقول بشكل مباشر.

الصور المعروضة للأشخاص، على اليسار، والذكاء الاصطناعي التوليدي يخمن ما يدركه الشخص، على اليمين.

لكن الأمر غير مباشر أكثر من ذلك بقليل. من خلال دراسة الشكل الذي يبدو عليه فحص الدماغ عالي التردد عندما ينظر الأشخاص إلى صور لأشياء معينة، مثل الخيول أو الطائرات، يتمكن الباحثون بعد ذلك من إجراء عمليات إعادة بناء في الوقت الفعلي تقريبًا لما يعتقدون أن الشخص يفكر فيه أو ينظر إليه . ومع ذلك، يبدو من المحتمل أن الذكاء الاصطناعي التوليدي له دور يلعبه هنا في كيفية إنشاء تعبير مرئي عن شيء ما حتى لو لم يتوافق مباشرة مع عمليات المسح.

يجب هل سنستخدم الذكاء الاصطناعي لقراءة أفكار الناس، إذا أصبح ذلك ممكنًا؟ اسأل DeepMind – انظر أعلاه.

وأخيرًا، مشروع في LAION أكثر طموحًا من الخرسانة في الوقت الحالي، ولكنه جدير بالثناء على الرغم من ذلك. يهدف التعلم المتباين متعدد اللغات لاكتساب التمثيل الصوتي، أو CLARA، إلى منح النماذج اللغوية فهمًا أفضل للفروق الدقيقة في الكلام البشري. هل تعرف كيف يمكنك التقاط السخرية أو الكذب من الإشارات اللفظية الفرعية مثل النغمة أو النطق؟ الآلات سيئة جدًا في ذلك، وهو خبر سيئ لأي تفاعل بين الإنسان والذكاء الاصطناعي. يستخدم CLARA مكتبة من الملفات الصوتية والنصوص بلغات متعددة لتحديد بعض الحالات العاطفية وغيرها من إشارات “فهم الكلام” غير اللفظية.